Simülasyon Teorisi 7 - Bostrom ve Bilgisayardaki Beyinler

Podcast Versiyonu (15.dk sonrası)

Modern teorinin ikinci kısmında, kavanozdan çıkıp yapay bilinç ve kuantum mekaniği dünyasına dalıyoruz: Bizzat ben şahsen kendim de simülasyon muyum?

Serinin Tüm Bölümleri

Modern Simülasyon Teorisinin Kalbi

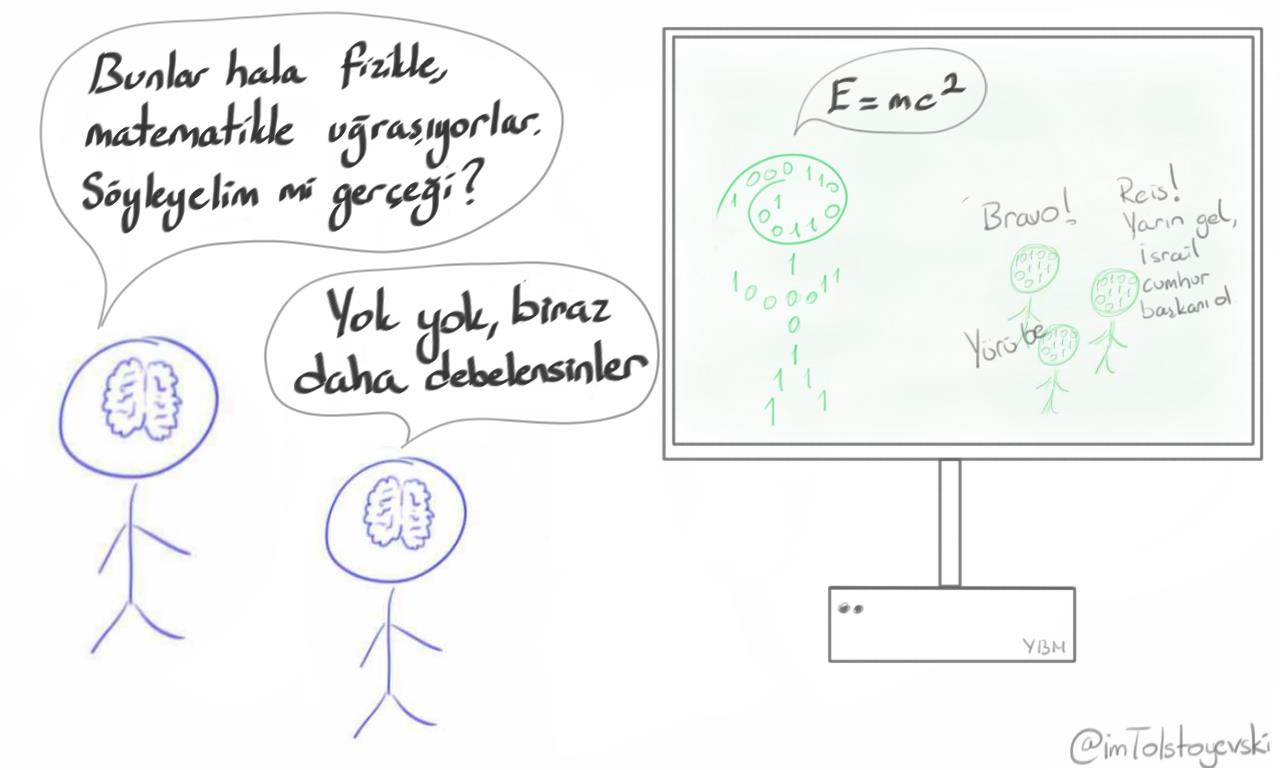

Yapay zeka konusunda felaket tellallığı ile tanınan Nick Bostrom, yaklaşık 15 sene önce şu makale yoluyla bir üçlem dile getirmişti (Evet, ikilem varsa "üçlem" neden olmasın):

Ya evrendeki uygarlıklar yüksek kalite simülasyon yaratacak seviyeye gelemiyorlar.

Ya o seviyeye gelebilen uygarlıklar var ama simülasyon yapmakla ilgilenmiyorlar.

Ya da neredeyse kesinlikle bir simülasyonuz.

Simülasyon konusundaki en çok atıf alan özet bu ve ben de serinin kalanını bu üç basit ihtimale ayırdım. (Ekstra kredi için, Bostrom'un İngilizce röportajı aşağıda).

Maddelere tek tek bakmadan önce bütünü anlamakta fayda var. Bostrom, "hacılar kesin simülasyondayız" demiyor, ilk iki ihtimal zayıfsa sonuncusunun doğru olacağını söylüyor. Bunu anlamak için bazı gizli varsayımlar yapmamız lazım...

Varsayalım İsmail

Bir simülasyondaysak, bizim evrenimiz dışardaki evrene yeterince benzer olmalı. Aksi halde, daha ilk dakikada metafizik denen aşılamaz duvara toslarız. Zaman-mekan üstü varlıkların sihirden farksız teknolojilerinden bahsetmekle, hayal edilemeyecek kadar kusursuz bir Tanrı'yı hayal etmeye çalışmanın arasında pek fark yok: İkisi de kısa ve sıkıcı. O yüzden temel bilgilerimizin, asıl gerçeklikte tamamen manasız olmadıklarını, sadece eksik olduklarını varsayıyoruz.

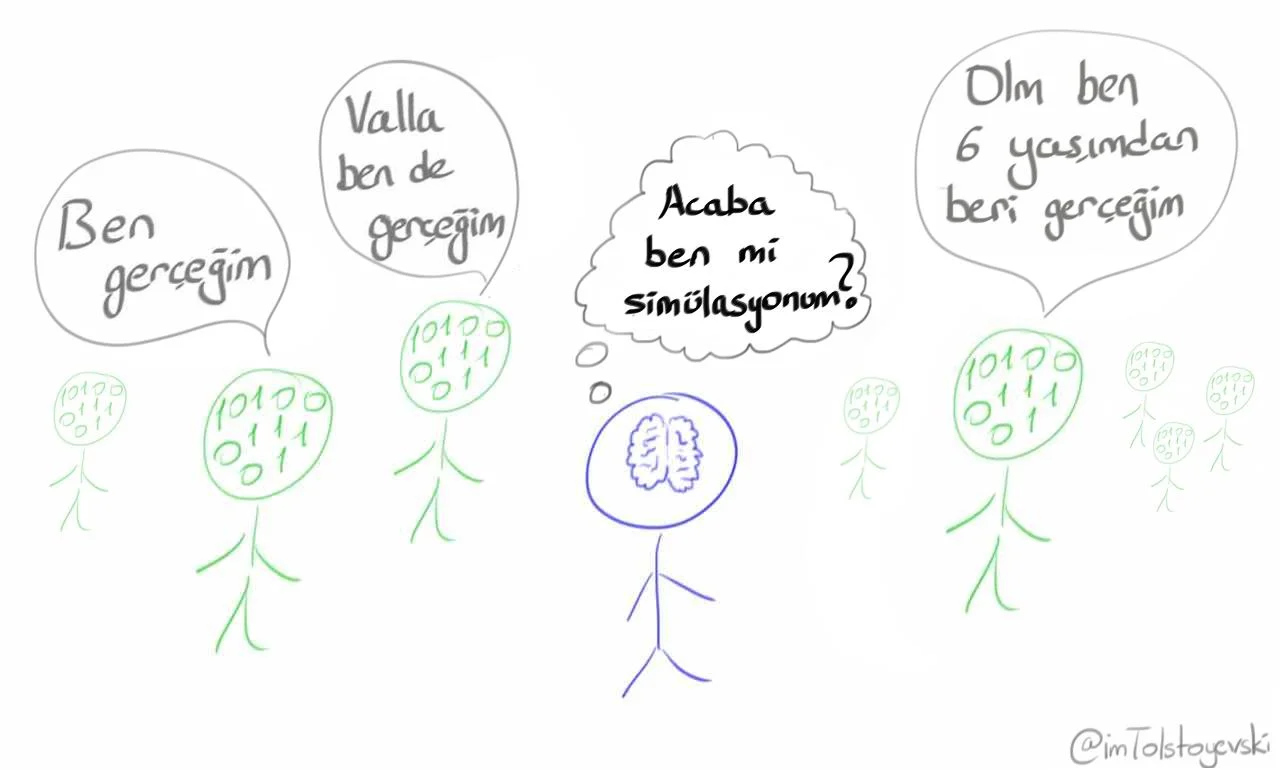

Simüle edilmiş bilinçler ("Sim") ile gerçek bilinçler epey benzeşmeliler. Mesela Sim'ler, Sim olduklarını bilmemeliler. Elbette bu çıkarıma bilim ve mantık yoluyla varabilirler ama sezgisel olarak bilemezler. Tıpkı bizim bilmediğimiz gibi. Şüphe esas. Bu sayede, herhangi birinin Sim olma ihtimali, evrendeki Sim sayısının, toplam bilinç sayısına oranı olacaktır.

Bu oran ya sıfıra ya da %100'e yakın. Çünkü simülasyon yapabilecek (madde 1) ve yapmak isteyecek (madde 2) ileri uygarlıkların oluşması imkansıza yakınsa, Sim sayısı çok olmaz. Ama en az birkaç uygarlıktan bahsediyorsak, ipin ucu kaçacaktır. Bir uygarlık aza kanaat getirip "sadece" 100 milyar Sim yaratsa bile, bir diğeri katrilyonlarca yaratır. Uygarlık sayısı arttıkça, potansiyel Sim sayısı geometrik olarak artıyor. Dolayısıyla bir noktada Sim olma ihtimalimiz %100'e yakınsıyor.

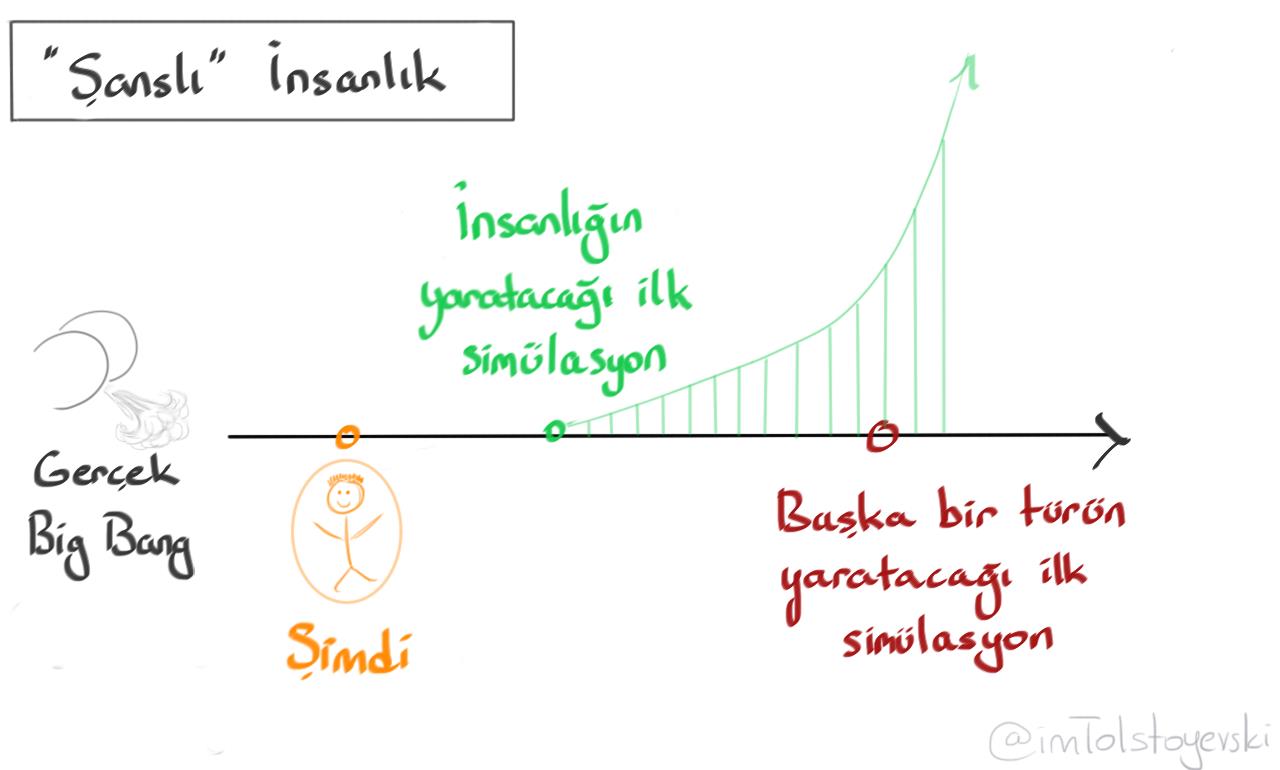

"Bu tip uygarlıklar mümkün ama henüz gelişmediler" demek de bizi kurtarmıyor çünkü aslen bir zaman kısıtımız yok. Bu uygarlıklar eninde sonunda kendilerini, komşularını veya atalarını simüle edecekler (Bostrom bunlara ancestor simulation diyor). O seviyeye 100 milyon sene sonra da ulaşsalar, simülasyondaki ataları için bir şey farketmeyecek ki. Kendimizi BBS (Big Bang'den Sonra) 13.7 milyar yılında sanıyoruz ama belki "dışardakiler" BBS 35 milyar yılındalar. Sonsuz zaman çizgisini düşünürsek, insanlığın ileri bir döneminde doğmuş/yaratılmış olmamız çok daha olası.

Dahası bu hesabı her uygarlık için düşünmemiz gerekir. Bizim simülasyon olma ihtimalimiz, sadece Güneş Sistemi'nde doğan bir türün teknolojik evrimine bağlı değil. Zira kendine "insanlık" diyen bizler, aslında evrenin diğer ucunda da olabiliriz. Önceki bölümde survivor bias'tan bahsetmiştim: "Koca evrenin tam bu köşesindeki bir uygarlığın Sim yaratma seviyesine gelme ihtimali ufak olmalı, öyleyse biz gerçeğizdir herhalde" diye düşünmek yanıltıcı. Dolayısıyla aşağıdaki "şanslı" senaryo epey düşük bir ihtimal.

Tüm bu varsayımların ve ihtimallerin iki doğal neticesi var:

Eğer halihazırda bir simülasyonda değilsek, torunlarımızın da simülasyon yarat(a)mayacaklarından neredeyse emin olabiliriz.

Günün birinde yüksek kalite bir simülasyon yaratırsak, neredeyse kesin olarak biz de simülasyonuz.

Paraleller, Fraktaller, Lanet Olası Federaller

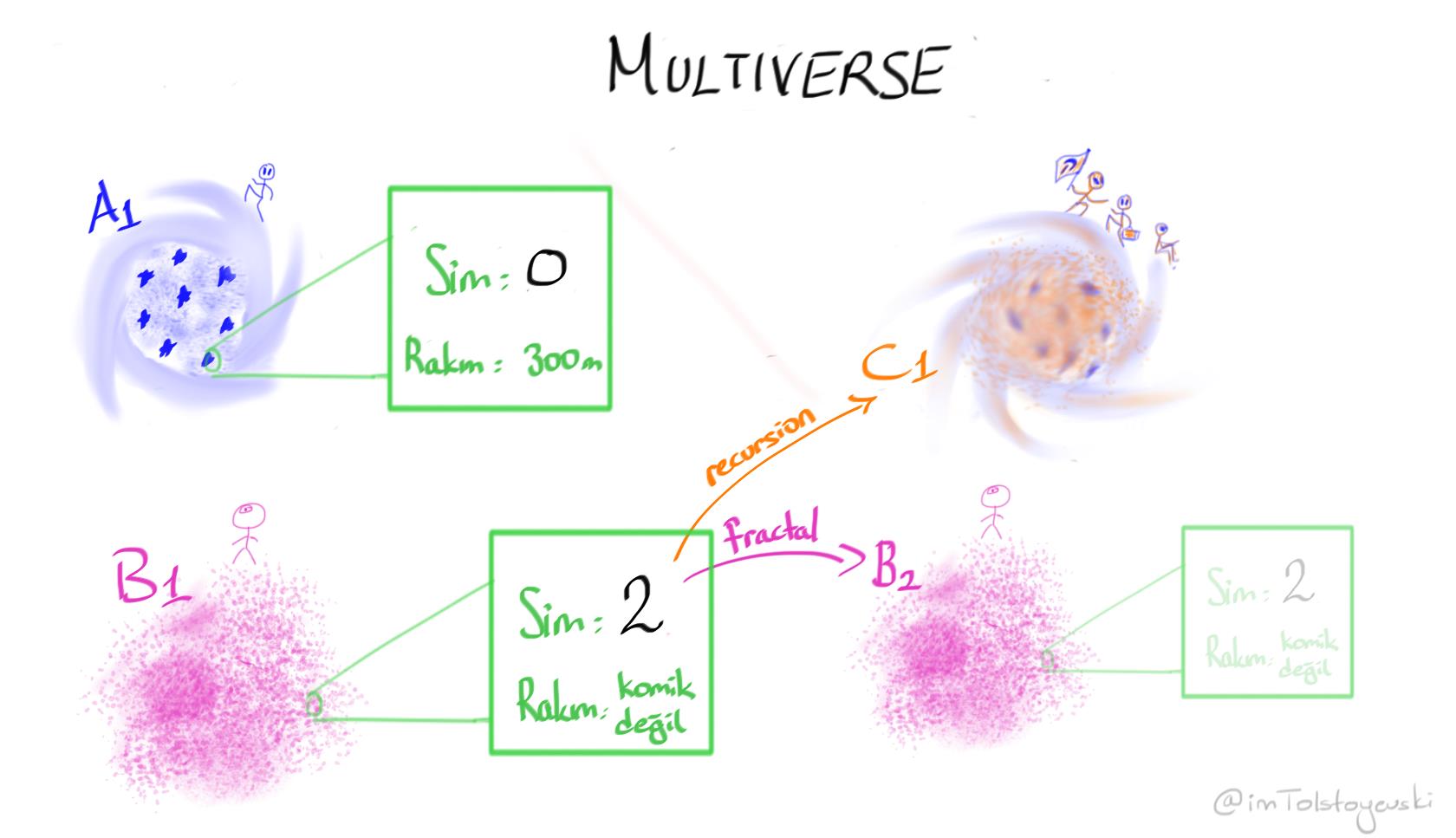

Sim sayısı, paralel evrenler kuramıyla da epey alakalı. Bu kuram doğruysa, inanılmaz sayıda değişik tipte evren olabilir. Örneğin Leonard Susskind 10^500 tipte evrenden bahsediyor (üstelik her bir tip tekrar tekrar yaratılabilir). Kıyas için, evrendeki atom sayısı 10 üzeri 80.

Bu rakamları kafamız almıyor. Yani düşün, 10^86 ile 10^80 arasında 1 milyon kat fark var. 500'e varana kadar kafayı yeriz.

Bu kadar fazla sayıda evren olunca, "eğer bilmemne sabiti biraz daha yüksek olsaydı hayat olmazdı, öyleyse bismillahirramanirrahim!" mantığı da çöpe gidiyor (anthropic principle). Çoğunda bırak hayatı, bir parçacık dahi meydana gelemez belki ama bir sürüsünde hayat olacaktır. Bazılarında da yapay bilinç yaratmak aşırı kolay olacaktır, zira fizik kanunları daha uygundur, yahut uygarlıklar daha erken evrilmiştir, vs.

Simülasyonu teşvik eden, girişimci dostu bu evrenlerin çoğunda, Sim'lerin kendi evren simülasyonu yapmalarına izin olmayabilir ama bazılarında enerji boldur, evren içinde evren içinde evren yaratılabilir rahatça. Halk arasında "la la aynı İnsepşın gibi" olarak bilinen recursion kavramı yani. (Türkçesi özyineleme imiş. Şu kelime günlük hayatta kaç kez kullanılmıştır acaba).

Daha da çılgını, bu recursive simülasyonlardan biri, bizzat simülasyonu yaratan uygarlığın aynısını doğurabilir. Yani baz gerçeklikteki bir uygarlık, kendi evrenini milyon kere simüle ederse, bir tanesinde kendi uygarlıkları tekrar oluşacak. Onlar da bir milyon evren simülasyonu yapacak ve döngü sürecek. Bu özel bir çeşit recursion, fraktal deniyor. Hiç tükenmeden birbirinin içinden çıkan Matruşka bebekleri gibi.

Dolayısıyla, George RR Martin R+L=J diyorsa, ben de M+R=F diyorum. Yani Multiverse ve Recursion, Fractal evrenlere yolaçar. Bu durumda bırak trilyonları, sonsuza yakın yapay bilinçten ve %100'e yakınsayan bir Sim olma ihtimalinden bahsediyoruz.

***

Tabii burada ufak bir absürdlük var: Multiverse fikri -doğru veya yanlış- bizi simüle eden kültürde de bulunacaktır. O zaman aynı mantıkla onlar da simülasyon olduklarını düşünecekler. Simülasyon hipotezinin değil ama multiverse fikrinin altını oyuyor bu biraz. Napalım, biz de kendi evrenimizdeki fraktallerle yetiniriz.

(Fraktal demişken, sizi en şahane Youtube kanallarından biriyle tanıştırayım. Adamın her videosu ayrı bir delilik. "Terry Gilliam ile Dali'nin çocukları olsa ve mantar tribine girseler ne yaparlardı"nın cevabı bu kanal)

Bilinç ve Zeka: AI, AGI, FBI (Lanet Olası Federaller 2)

Genel mantık akışını ve varsayımları anladık. Şimdi Bostrom'un üçlemine daha yakından bakalım. İlk madde:

"Ya evrendeki uygarlıklar yüksek kalite simülasyon yaratacak seviyeye gelemiyorlar..."

Bir uygarlığın bilinç ve evren simülasyonları yapacak seviyeye gelmesini ne engelleyebilir? Üç çeşit sebep aklıma geliyor:

Teorik limitler (özellikle yapay bilinç hakkında)

Pratik limitler (kaynak eksikliği, kuantum seviyesinde bir simülasyon için gereken işlemci gücü)

Varoluşsal tehditler (uygarlığımızın gelişmesini istemeyen, bizi kıskanan iç ve dış mihraklar)

***

Sırayla gidelim. Matrix gibi bir VR ortamı yaratabileceğimiz kesin ama bilincin kendisini simüle etmek daha ikircikli: Kolayca üretilebilen gerçek yapay zeka teoride mümkün mü?

Buradaki "gerçek yapay zeka" ve "kolayca üretilebilen" kalıplarını açmakta fayda var. Gerçek yapay zeka (strong AI) ile geçen bölüm tanışmıştık. Orada bilinç ile zekayı sürekli beraber kullandığımdan biraz kafa karışıklığı olabilir. Max Tegmark bunların farkını Life 3.0 kitabında tartışmış, anladıklarımın bir özetini geçeyim:

Dar alanda kısa paslaşmalar yapan zekalar epey yaygın. Örneğin satranç programları, borsa algoritmaları, vs, hepsi dar anlamda zeki. Fakat bir bilinç sahibi olmadıkları kesin gibi.

AI ile kastedilen daha ziyade AGI (artificial general intelligence), yani insanın yaptığı her şeyi yapabilen genel bir zeka. Geçen bölümdeki Chinese Room deneyi, bilinçsiz bir şeyin de bu kadar zeki olabileceği hakkındaydı.

Bilinç ne? Basit hali farkındalık, dikkat, hafıza gibi kavramları içeriyor. Bu anlamda, bir sineğin de bilinci var, Chinese Room'un da.

Bunun bir adım ötesi özfarkındalık. Bazı hayvanlar kendilerini aynada tanıyabiliyorlar. Bir AGI'ın da bunu yapamadığını hayal edemiyorum. Ama muhtemelen bu insan-merkezli düşünme yatkınlığımdan kaynaklı.

Bilincin son noktası ise subjektif tecrübe (qualia). Qualia ile zeka ayrı ayrı evrimlesmiş olabilirler. Dolayısıyla ikisi de birbirini gerektirmiyor. Bir AGI'ın qualia sahibi olmasına gerek yok.

Bizim de yoktu aslında. Suyun soğuk olup olmadığını anlamak için, illa soğuk hissini duymamız gerekmiyordu. Bir termometrenin soğuğu ölçmesi için üsümeye ihtiyacı var mı? Yahut, bir kaplan görünce niye korku hissini duymak zorundayız? Kaplan görüntüsü ile bacak kaslarım arasına böyle bir aracı girmesine gerek yoktu.

İşin aslı "qualia neden var ki?" veya "bir canlı qualia sahibiyse bunu nasıl anlarız?" bilinçle ilgili en zor sorular. O kadar zor ki, hard problem of consciousness diye bir terim var. Ama bir şekilde qualia sahibi olduğumuza göre, eğer biz simülasyonsak, bunun da simüle edilebiliyor olması şart.

Bunların hepsini toplarlarsak: Bundan sonra "bilinç" veya "zeka" kelimeleriyle kastettiğim şey, subjektif iç tecrübeleri olan bir genel zeka olacak. Yani strong AI = AGI + Qualia. Bu epey yüksek bir standart. Bunu simüle edebilirsek, biz de büyük ihtimale simülasyonuz demek.

Functionalism: Lezzetli Bir Simülasyon İçin Gerekli Baharat

Peki "kolayca üretilebilen" derken neyi kastetmiştim?

Eğer insan bilinci, illa sinir sistemi gerektiyorsa, kavanozdaki beyin senaryolarının ötesinde bir simülasyon çok zor. Beyni yetiştireceksin de, içindeki kimyasal dengeleri sağlayacaksın da, gerektiğinde sinapsları yeniden programlayacaksın da, çürümesini önleyeceksin de, ölme eşeğim ölme. Bunlar mümkün olsa bile ölçeklenebilir değil, kimse bunu milyarlarca kez tekrarlamaz.

Vıcık vıcık dokulardan oluşan bu wetware'e kıyasla daha dayanıklı ve ucuz olacak bir hardware geliştirmek mümkün. Örneğin bu makalede bir nano-örgüden bahsediliyor.

Sadece 4 mm karelik bu örgüde milyonlarca yapay sinaps var. Beyni andıran bir kaosla oluşturulmuş. Ama tamamen rastgele de değil; sisteme elektrik verildiği zaman değişik örüntüler (pattern) ortaya çıkıyor. Bunların çoğu kısa süreli, bazısı ise uzun süre devam ediyor.

Bu önemli, çünkü insan beyninin de bu denge noktasında çalıştığını düşünüyorlar. Yani her aktivite sadece mikrosaniyeler sürse ve yayılmasa, karmaşık örüntüler oluşamazdı. Yok eğer aktiviteler hep uzun sürseler, bu sefer de sistemdeki her nöron tetiklenecek, muhtemelen mavi ekran vereceğiz. Bilinç, bunların arasındaki yarı-kaotik, yarı-düzenli bölgede ortaya çıkıyor muhtemelen.

***

Fakat asıl devrim, wetware'i veya hardware'i bırakıp, bilinci software'de oluşturmak (Çare Linux!). Altında yatan fiziki platformdan bağımsız bir sanal bilinci çoğaltmak veya yeniden programlamak bedava. Simülasyon için en uygunu bu. Ama bunun teoride dahi imkansız olduğunu düşünenler var. Geçen bölümdeki Chinese Nation örneği, bu functionalist yaklaşıma karşıydı.

(Bazı terimleri bilerek Türkçeleştirmiyorum, çünkü o terimlerin arkası yok. Mesela "fonksiyonalizm" vikipedi sayfası boş, "işlevselcilik" sayfası ise sadece sosyoloji hakkında. Subliminal mesajı veriyorum: Coca Cola için, İngilizce öğrenin).

Odamdaki Kara Delik

Functionalism karşıtları basitçe şunu diyor: Eğer bilgisayarınızda bir kara delik simülasyonu yaparsanız, odanızda kara delik oluşur mu?

Hayır. Yani denemedim ama sanmıyorum oluşacağını. Kara delik, fiziksel altyapı gerektiren bir olgu. İklim simülasyonu yapan süperbilgisayarlar üşüyorlar mı, fırtına yaratıyorlar mı?

Aynı şeyi bilinç için de düşünebiliriz: Bilgisayarınızda çalışan kod, sinapsların işlevlerini en ince ayrıntısına kadar taklit etse de bir bilinç yaratamaz. Belki bambaşka çeşit bir bilinç yaratacaktır, bilemeyiz, ama insan benzeri bir bilinç için fiziki altyapı şart. Artık bu altyapı nano-örgü mü olur, yok illa beyin mi, orası ayrı bir tartışma.

(Ben "illa beyin" diyen tayfaya karşıyım. Karbon bazlı biyolojik yapıların, taklit edilemez özellikleri olması fikri komik geliyor. Tam bir karbon şövenizmi).

***

Functionalism için kara delik örneğinden de sorunlu bir senaryo var: Tüm simülasyon kodunu ezberlemiş bir savant.

Düşünün, gerekli tüm işlemler kafasının içinde. Bu yetmemiş, kodu compile etmesi için gereken bilgileri de ezberlemiş. Sonuçta bir bilgisayarın kod işlemesi demek, hafızadaki bitleri belli bir sırayla değiştirmek demek. Savant bu işlemlerin hepsini ezberleyip, tam sırasıyla düşünürse ne olur? Kendi beyninde ikinci bir bilinç mi simüle etmiş olur? Malkovich Malkovich? Burada o bilinci yaratamıyorsa, bilgisayarda çalışan kod nasıl yaratsın?

Bunun cevabını bilmiyorum. Ama bundan da radikal bir fikir olan Tegmark'ın Matematiksel Evren Hipotezi, simülasyon umudunu arttırıyor...

Bu hipoteze göre matematik, fiziksel gerçekliği tarif eden bir dil değil, o gerçekliğin özü. Bazı karmaşık matematiksel yapılar, bilinç sahibi oluyorlar (biz) ve gerçekliği fiziksel evren şeklinde algılıyorlar. Dolayısıyla bir şeyi simüle etmek için matematiğini oluşturmamız yeterli. Bu da ilerde simülasyon yapabilmemizi -ve bizim de Sim olmamızı- kolaylaştırıyor.

Tegmark'a göre "hesaplanabilen her şey gerçekte vardır". (Dönüp dolaşıp Platon'a ve Pisagor'a geldik)

Galaksinin En Kral Toplama Bilgisayarı

Gerek matematiksel olsun, gerek yazılımsal, gerekse fiziksel, bu zekanın eninde sonunda pratiğe dökülebilmesi için yeterli bir hesap gücü gerekiyor. Bu altyapıya sahip olabilir miyiz, pratik limitlerimiz neler?

Birim alana sıkıştırılabilen transistör sayısının, katlanarak arttığını gösteren Moore's Law artık yavaşlıyor. Fiziki sınıra iyice yaklaştık, transistörler daha da küçülemeyecekler. O yüzden bambaşka bir teknoloji olan kuantum bilgisayarlarından medet umuyor herkes. IBM meraklılara özel bir sayfa hazırlamış, tavsiye ederim. Bizim için önemli olansa, bir bilinç/evren simülasyonu yapacaksak, bunun transistörlerde çalışmayacağı.

Evet, şu anki sistemler bazı karmaşık işlemleri yapabiliyorlar ama 3-4 yaşındaki bir çocuk beyninin 20 watt güç kullanarak yaptığı bir sürü basit işlem (görüntü tanıma, el-göz koordinasyonu, denge, vs), megwatt'larca güç harcayan süperbilgisayarlar için bile zor. Yapay zeka alanında "basit" problemlerin çok fazla kaynak gerektirmelerine, Moravech Paradoksu deniyor. Steven Pinker bu durumu güzel özetlemiş:

"The main lesson of thirty-five years of AI research is that the hard problems are easy and the easy problems are hard."

("35 yıllık bilimadamıyım, böyle saçmalık görmedim")

İnsan beynini tamamen taklit etmek için tahminen saniyede 10^17 işlem yapmak gerekiyor (kaynak: bazı zeki insanların beyinleri). 100,000 teraflop demek bu. Günümüzdeki en hızlı süperbilgisayarın işlem gücü 100 teraflop civarı. Yani tek bir insan beynini simüle etmek için, Çin'in yüzlerce milyon dolar gömdüğü bir projeden aynı anda bin tane olması lazım. İlla Kasparov'un beynini kastetmiyorum, mesela Burhan Kuzu'nun beyni için de 1000 tane süperbilgisayar gerekiyor. Hayat garip.

***

Tüm insanlık tarihini simüle etmek için ne gerekli? Eğer simülasyonun kişiye özel olmadığını, herkesin strong AI olduğunu farzedersek, şu ana kadar yaşamış 100 milyar insan çarpı ortalama 50 sene ömür, toplam 10^36 işlem ediyor. Bu rakam korkunç ama Bostrom'un makalesine göre, gezegen büyüklüğünde bir süperbilgisayarın saniyede 10^42 işlem yapabileceği tahmin edilmiş. Ve bu muhafazakar bir tahmin.

Böyle bir süper-bilgisayar, bir saniye içinde tüm insanlık tarihinin tam 1 milyon ayrı varyasyonunu simüle edebilir. Benzer bir hesap aşağıdaki videoda anlatılıyor.

Simülasyonun Log Dosyaları

Bu hesaplar eksik aslında: Bir simülasyonun maliyeti, simüle ettiğiniz şeyin karmaşıklığından daha fazla olmak zorunda, çünkü o simülasyon hakkında veri toplamanız lazım, yani meta-data. Eğer simülasyon hakkında bir şey öğrenemeyeceksem, onu çalıştırmamın manası ne?

Bazı durumlarda meta-data, datadan da büyük olabilir. Mesela her yapmadığımız seçim, her vermediğimiz karar bir log dosyasına yazılıyorsa, log sisteminin katbekat hızlı çalışması lazım. (Paralel evrenleri bu tarz bir log dosyası olarak düşünebiliriz).

Yahut simülasyon epey büyükse, log sistemi sadece "önemli" olayları kaydedecektir: Mesela bir uygarlığın uzaya radyo sinyalleri yollamaya başlaması, atomu parçalaması, Melih Gökçek'in istifası gibi önemli olayları inceleyen analistler olabilir. Ya da biz figüranız, asıl ilgilendikleri süpernova patlamaları ve karadelikler.

Aslında hiçbir analizle ilgilenmeyen bir simülatör de hayal edebiliriz. "İyilik yap denize at" hesabı, simülasyonu başlatıp gitmişler. Bunu sırf yeni hayatlar yaratmanın değeri için yapıyorlar ve o hayatları incelemenin ahlaksızlık olduğunu düşünüyorlar. Belki bunların dininde antropoloji en büyük günah, log dosyaları en büyük tabu.

Kimsenin Olmadığı Ormanlarda Bağıra Çağıra Düşen Ağaçlar

Her halükarda bu simülasyonlar insan beyninden ibaret olmayacaklar. Eşyalar, hayvanlar, gezegenler, Bülent Ersoy, hepsi ayrıyeten işlemci gücü gerektiren şeyler. Dünya tarihindeki tüm virüsleri simüle etmek, son 200 bin sene yaşamış sapiensleri simüle etmekten daha zor olmalı.

Tabii simülatörlerimiz, filozof Berkeley gibi idealist değillerse. Kimsenin olmadığı bir ormanda düşen bir ağacın ses çıkarmasına gerek var mı sizce? Öyle bir ağacın, öyle bir ormanın olmasına dahi gerek olmayabilir. Kimse bakmıyorken uzak galaksilerdeki yıldız çarpışmaları niye simüle edilsin?

Bunları sadece biri baktığı anda, on-demand yaratmak ilk bakışta mantıklı ama bir sorun var: Gözlemlerimiz tutarlılık gösteriyor, yani bilimsel kanunlar var. İki gözlem arasında, gezegenlerin tam da Newton mekaniğine uygun şekilde yer değiştirmelerini sağlamak için, arkaplanda bir işlem yapılması gerekir. Windows'daki background process'ler gibi. Gözleyen biri yokken simülasyon düşük kalitede çalışıyordur, biri teleskopla bakınca da detay artıyordur.

Aslında işin HD kısmı, bilinç simülasyonunun bir parçası olarak simüle edilebilir, yani o 10^17'lik rakamın içinde olur. Çünkü aynı anda hem bilinçten bağımsız bir gerçekliği (realizm), hem de bu gerçekliğin bilinçteki yansımasını yüksek kaliteyle simüle etmek hamallık. Gerçeklik, hep düşük detaylı bir simülasyon olarak arkaplanda çalıssa da olur.

Kuantumun Maliyeti

Aslında uzaktaki devasa yıldız sistemlerine kadar gitmeye gerek yok, bu muhabbet tam da kuantum mekaniğinin özü. Bakmadığımız her parçacık, aynı anda birden fazla durumda var olan birer matematiksel yapı, Tegmark'ın deyimiyle.

Klasik çift yarık deneyini düşünün: Foton, biz gözlem yapmazken dalga gibi davranıp iki yarıktan da geçiyor ama yarıklara dedektör koyunca, parçacık olarak davranıp iki yarıktan birini seçiyor (HD kalitesine bürünüyor gibi düşünün).

Daha da garibi, evinizde bile yapabileceğiniz bir kuantum deneyi: İki tane polarize gözlük alın, birini 90 derece döndürerek üstüste koyun ve bir ışık kaynağına bakın. Karanlık olacak. Şimdi üçüncü bir gözlüğü alıp, bu ikisinin arasına sıkıştırırsanız, daha da karanlık olmasını beklersiniz değil mi? Beklemeyin. Işık şiddeti artacak.

Bunun açıklaması aşağıdaki videoda uzunca yapılmış, vardıkları sonuç:

Ya Realizm yalan, yani parçacıklar biz gözlem yapmadan önce bir veri taşımıyorlar, örneğin bakmadığımız bir ağacın kütlesi filan yok.

Ya da ışıktan hızlı seyahat mümkün, hatta bilgi anında sonsuz mesafeleri aşabilir.

İlk bakışta bu gariplikler, performans optimizasyonu yapılmış bir simülasyonu andırıyor. Mesafelerin anlık olarak aşılmaları bir enerji tasarrufu. Sadece olasılık fonksiyonlarını simüle etmek ve ancak gözlemlenince onların içini veriyle doldurmak da. Tıpkı, bir bilgisayar oyununda, daha gitmediğiniz bir odanın render edilmemiş olması gibi. Siz oyunda ilerledikçe yaratılıyor mekanlar.

Fakat ben bu fonksiyonların "ucuz" oldukları varsayımından emin değilim. Geçenlerde bir grup fizikçi, tam da bu nedenle, bir simülasyonda yaşamadığımızı kanıtladıklarını duyurmuştu.

Argümanları şuna dayanıyor: Kuantum seviyesindeki hesap karmaşıklığı, geometrik olarak artıyor. Alt tarafı 200 elektronu simüle edebilmek için gereken bilgisayar hafızasının büyüklüğü, evrendeki tüm atomların toplamından fazla. Dolayısıyla bir insan beynini sinaps seviyesinde (işlem seviyesinde) simüle etmek süperbilgisayarlarla mümkün olabilir ama kuantum seviyesinde bu imkansıza yakın. Onu bırak, kimsenin bakmadığı, duymadığı bir ağacın simülasyonu dahi çok maliyetli.

Tabii ki simülasyon içindeki fizik kuralları dışarıyı bağlamak zorunda değil. Oradaki bir uygarlığın çok daha verimli algoritmaları vardır, yahut sonsuz enerjileri vardır, umursamıyorlardır sorunu. Ama o zaman da, kuantum mekaniğindeki gariplikleri, işlemci gücü tasarrufunun yan etkisi olarak görmek mantıksız.

Great Filters ve Fermi Paradoksu

Bostrom'un birinci maddesini bitirelim: Eğer teorik ve pratik altyapı mümkünse, uygarlıkların önünde başka ne engel olabilir? Geldik varoluşsal tehditlere.

Buradaki mantık Fermi Paradoksu ile aynı. Orada "madem evren 13.7 milyar yaşında, nerede bu uzaylılar?" diye soruyorduk. Şimdi de "simülasyonda değilsek, simülasyon yaratabilecek uygarlıklara ne olmuş olabilir?" diye soruyoruz. İki sorunun da cevabı Great Filter kavramını içeriyor: Belki her uygarlık, bir noktadan sonra aynı duvara tosluyor.

Fermi'yi, Great Filter'ı ve Kardashev Ölçeği'ni anlatmak için, bol çizimli ek bir bölüm yazdım. Bence tamamını okuyun ama burada, simülasyonla ilgili kısıma değineceğim sadece: Ya simülasyon seviyesine gelmek üzere olan her uygarlık, bir şekilde kendi kendini yokediyorsa?

Örneğin benim en çok korktuğum senaryo bir "nanobot soykırımı".

Nanoteknolojiye ulaşmamız an meselesi ve her türlü silahtan daha öldürücü potansiyel olarak. Yeterli enerji olduğu sürece, her molekülü değiştirme gücümüz olduğunu düşünün.

Zaten en kötümser yapay zeka senaryoları da nanoteknolojiyle elele gidenler: Yapay zeka kontrolden çıkıyor, nanoteknoloji sayesinde her objeyi amacı doğrultusunda bir kaynak olarak kullanıyor. Yine Bostrom'a ait Paperclip Maximizer deneyi bunun klasik örneği. Tek satırlık bir kod hatası yüzünden, bu modern simyacılar, galaksideki her canlıyı altına dönüştürebilirler.

Burada insan benzeri bir yapay zekadan (AGI) bahsetmiyorum. Öyle bir zeka bizi yokederse, bu Bostrom'un ilk maddesi için bir örnek olmaz, zira bu sefer simülasyon teknolojisine onlar erişebilirler. Yani bu bir evrim olurdu, yokoluş değil. Oysa bu Great Filter duvarı öyle bir şey olmalı ki, ileri uygarlıklardan geriye kalan hiçbir şeyle kontak kuramıyoruz. O yüzden uygarlığı bitiren şey yapay zeka ise, bu kendi amacını sorgulayamayan, hatta tamamen bilinçsiz bir yapay zeka olmalı.

***

Yahut bunun savaş ve barışla bir alakası yok da, suç ve ceza ile alakası var. Yani bir dış mihrak, belli bir seviyeye gelme suçu işleyen her uygarlığı yokediyor. (Mass Effect serisinin Reaperları, 50 bin senede bir gelip fazla gelişmiş organik uygarlıkları temizliyorlardı).

O hakim ırk da hiç bir simülasyon yapmıyor. Onlar sayesinde evrendeki her bilinç "gerçek". Belki de bunu sağlamaya çalışan bir grup dini fanatik bunlar. Simülasyon en büyük günah.

Bir Kötü Haber, Bir de Kötü Haber

Tüm bu senaryolar, şunu varsayıyor: Türümüzü yokedebilecek her şey, ileri simülasyon teknolojilerinden daha önce ulaşılabilir olmalı. Yani olası bir Great Filter, bilinç simülasyonu yapmaya başladıktan sadece 100 sene sonra gelecekse dahi, bu sayısız simülasyon demek ve biz de muhtemelen o zaman aralığında meydana gelmiş yapay bilinçleriz.

Bu mantıkla, eğer torunlarımızın simülasyon teknolojisine eriştiklerini görürsek, bu demektir ki çok büyük ihtimalle biz de simülasyonuz.

***

Yok eğer Bostrom'un bu ilk ihtimali doğruysa, yani gerçek bir simülasyon yaratmak aşırı nadir bir durumsa, biz de muhtemelen hiçbir zaman simülasyon sahibi olamayacağız. Great Filter'ı geçmiş olan tek uygarlık olmamız ihtimali sıfıra yakın. Dolayısıyla büyük olasılıkla daha bu filtreye gelmedik.

Bu kötü bir haber değil. Zira en iyi ihtimalle, simülasyon için yeterli teknik bilgiye sahip olamayacak kadar yavaşlayacak teknolojik gelişimimiz. En kötü ihtimalle ise bir şey bizi öldürecek ve bu muhtemelen yakın zamanda olacak, çünkü simülasyon teknolojisi epey yakınımızda görünüyor.

Her iki halde de hepimize geçmiş olsun.

***

Gelecek Bölüm

Fermi Paradoksu'nu, yedibuçukuncu bölüm olarak araya sıkıştırdığımı söylemiştim.

Asıl devam bölümlerinde ise, Bostrom'un üçleminden geriye kalan iki maddeyi de bitireceğiz. Bir simülasyon yaratmanın bilimsel yararını, bunu sürdürmenin ahlakını, bitince ne olabileceğini konuşacağız. Ve simülasyonda olduğumuza dair başka kanıtları. Haydi sağlıcakla. -Simmanuel